Vous allez voir, nous avons quelques exigences pour ce challenge!

Nous sommes très inquiets de la profondeur du clustering (qui donne une indication sur l’efficacité du pruning) cette semaine. Nous devons donc créer un DAG de tâches qui surveillera cela.

Créez la table suivante :

create or replace table cluster_depth_monitoring (

database_name varchar,

sceham_name varchar,

table_name varchar,

clustering_depth float,

inserted_at timestamp,

inserted_by varchar

);

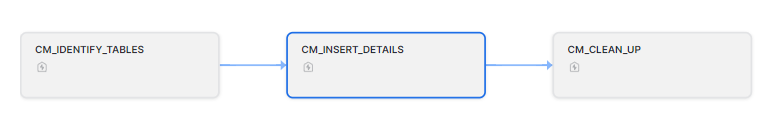

Nous voulons un DAG comme celui ci-dessus où:

CM_IDENTIFY_TABLES:

– identifie les tables de votre base de données qui sont clusterisées.

– crée une table transitoire avec ces informations:

CM_INSERT_DETAILS:

– exécute une procédure stockée Snowpark qui examine la profondeur de clustering de chacune de ces tables

– insère le résultat dans la table cluster_degree_monitoring

CM_CLEAN_UP:

– supprime la table transitoire créée par CM_IDENTIFY_TABLES

Et surtout, nous voulons que toutes ces tâches associent un tag « cluster_degree_monitoring » à leurs requêtes.

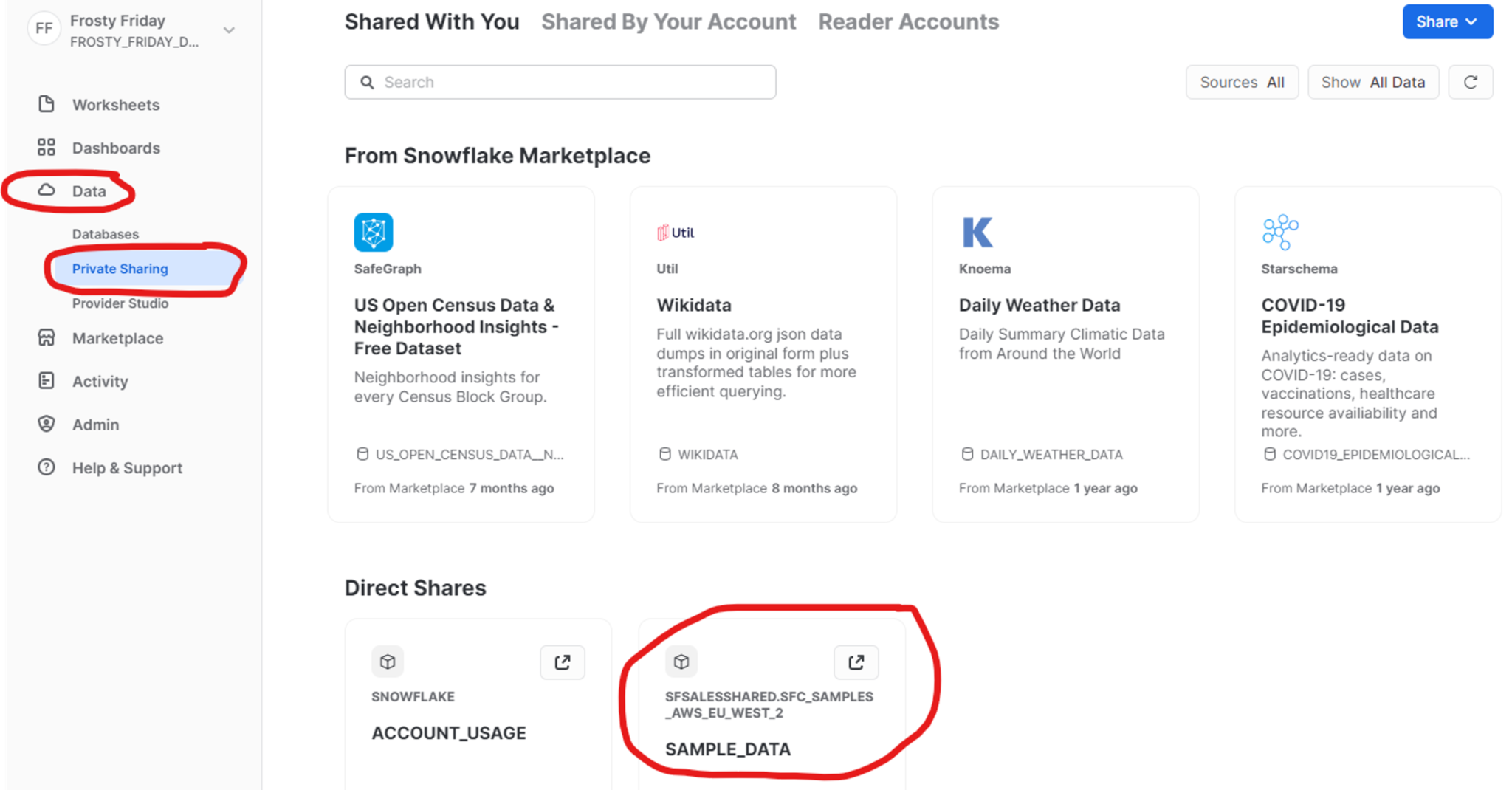

Utilisez la base de données SNOWFLAKE_SAMPLE_DATA partagée par Snowflake.

Votre résultat final devrait ressembler à ceci:

Et n’oubliez pas, si vous souhaitez participer aux défis:

1. Inscrivez-vous en tant que membre de Frosty Friday. –> Vous pouvez le faire en cliquant sur la barre latérale, puis en cliquant sur ‘REGISTER‘ (notez que s’inscrire à notre liste de diffusion ne vous donne pas de compte Frosty Friday).

2. Publiez votre code sur GitHub et rendez-le accessible au public (consultez notre guide si vous ne savez pas comment faire, disponible ici)

3. Postez l’URL dans les commentaires du défi.

Si vous avez des questions techniques que vous souhaitez poser à la communauté, vous pouvez les poser ici, sur notre thread dédié.

Laisser un commentaire

Vous devez vous connecter pour publier un commentaire.